Van alle enge krachten van internet is het vermogen om nietsvermoedend te misleiden misschien wel het meest beangstigend. Clickbait, gephotoshopte foto's en vals nieuws zijn enkele van de ergste overtreders, maar de laatste jaren is er ook een nieuwe potentieel gevaarlijke tool ontstaan die bekend staat als deepfake artificial intelligence (AI).

De term deepfake verwijst naar namaak, door de computer gegenereerde video en audio die moeilijk te onderscheiden is van echte, ongewijzigde inhoud. Het is om te filmen wat Photoshop is voor afbeeldingen.

Hoe werkt deepfake AI?

De tool is gebaseerd op wat bekend staat als generative adversarial networks (GAN's), een techniek die in 2014 is uitgevonden door Ian Goodfellow, een Ph.D. student die nu bij Apple werkt, meldde Popular Mechanics.

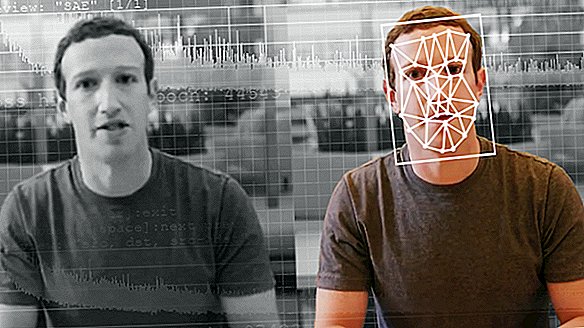

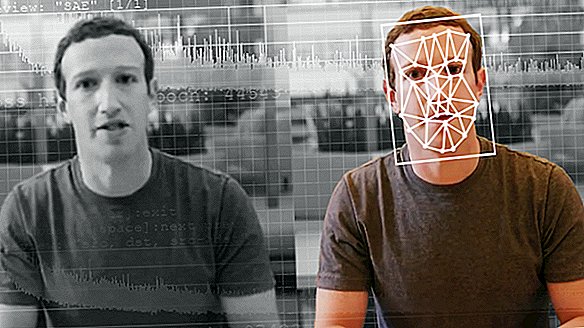

Het GAN-algoritme omvat twee afzonderlijke AI's, een die inhoud genereert - laten we zeggen foto's van mensen - en een tegenstander die probeert te raden of de afbeeldingen echt of nep zijn, volgens Vox. De genererende AI begint met bijna geen idee hoe mensen eruit zien, wat betekent dat zijn partner gemakkelijk echte foto's van valse kan onderscheiden. Maar na verloop van tijd wordt elk type AI steeds beter en uiteindelijk begint de genererende AI inhoud te produceren die er perfect levensecht uitziet.

Deepfake-voorbeelden

GAN's zijn indrukwekkende tools en worden niet altijd gebruikt voor kwaadaardige doeleinden. In 2018 werd een door GAN gegenereerd schilderij in navolging van de Nederlandse "Old Master" -stijl van kunstenaars zoals de 17e-eeuwse Rembrandt van Rijn verkocht op het veilinghuis van Christie voor een ongelooflijke $ 432.500.

In datzelfde jaar steeg deepfakes tot wijdverbreide bekendheid, voornamelijk door een Reddit-gebruiker die de naam 'deepfakes' droeg, 'meldde Vice. De GAN-techniek werd vaak gebruikt om de gezichten van beroemde beroemdheden - waaronder Gal Gadot, Maisie Williams en Taylor Swift - op de lichamen van pornografische filmactrices te plaatsen.

Andere GAN's hebben geleerd om een enkele afbeelding van een persoon te maken en redelijk realistische alternatieve foto's of video's van die persoon te maken. In 2019 kan een deepfake griezelige maar realistische films opleveren van de Mona Lisa die in verschillende posities praat, beweegt en glimlacht.

Deepfakes kunnen ook audiocontent wijzigen. Zoals eerder dit jaar door The Verge is gemeld, kan de techniek nieuwe woorden in een video van een sprekende persoon samenvoegen, waardoor het lijkt alsof ze iets zeiden dat ze nooit van plan waren.

Het gemak waarmee de nieuwe tool kan worden ingezet, heeft mogelijk angstaanjagende gevolgen. Als iemand waar dan ook realistische films kan maken met een beroemdheid of politicus die spreekt, beweegt en woorden uitspreekt die ze nooit hebben gezegd, worden kijkers gedwongen meer op hun hoede te zijn voor inhoud op internet. Luister bijvoorbeeld naar de waarschuwing van president Obama tegen een "vervaagde" dystopische toekomst in deze video van Buzzfeed, gemaakt met deepfake van filmmaker Jordan Peele.